全球自然语言处理领域的顶级会议EMNLP2023于12月6日-12月10日在新加坡召开,会议共接收4909篇投稿,主会录用论文1047篇,录用率21.3%。EMNLP的全称是ConferenceonEmpiricalMethodsinNaturalLanguageProcessing,由国际计算语言学会ACL组织每年举办一次,为自然语言处理领域最具影响力的国际会议之一。本次会议,微信AI团队有8篇文章被选中。其中,由北京大学和微信AI团队合作的文章获得EMNLP录取文章中最佳长论文奖(BestLongPaperAward),这也是EMNLP会议上国内首篇获此殊荣的论文。

图1.获奖论文

图2.获奖证书

微信AI团队榜上有名,参与研究文章获主会最佳长文

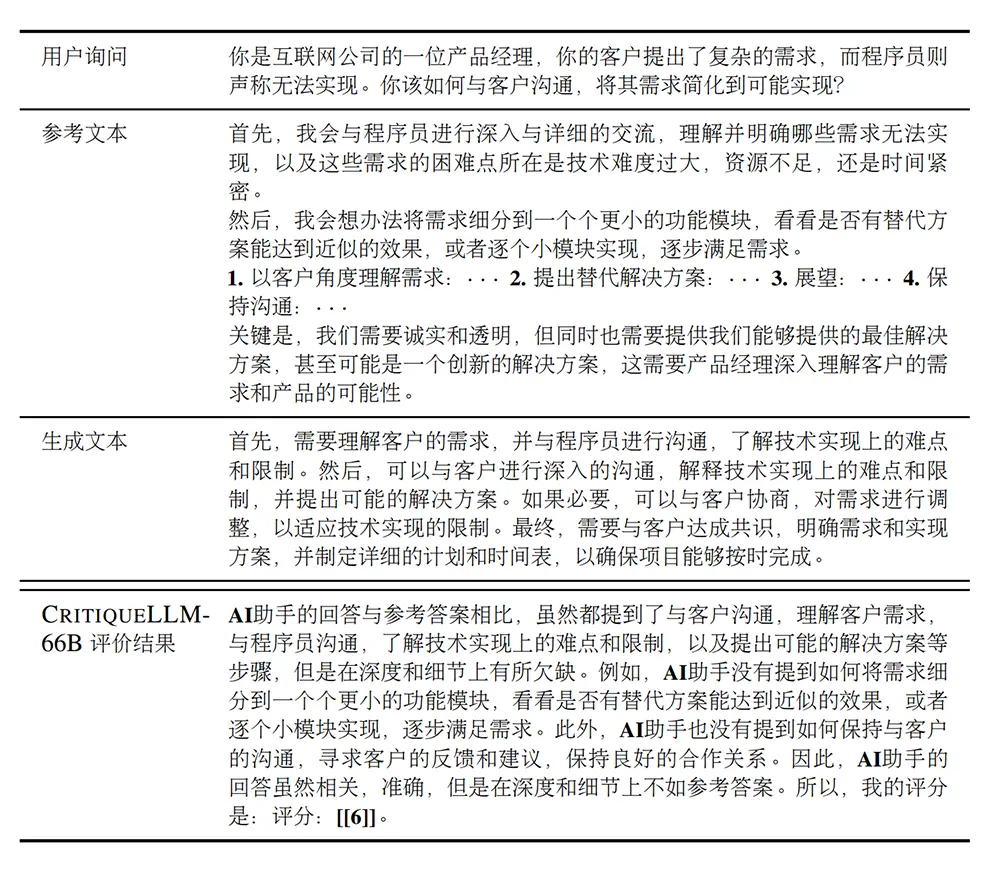

此次获奖的论文题为“LabelWordsareAnchors:AnInformationFlowPerspectiveforUnderstandingIn-ContextLearning”,研究了In-contextlearning(ICL)的工作机制。首次发现了上下文学习中演示示例的标签词起着“锚点”作用:1)在浅层计算层的处理过程中,语义信息聚集到标签词表示中;2)在深层计算层的处理过程中,标签词中的聚合的信息为语言模型的最终预测提供参考。基于这些发现,文章进一步提出了“锚点重新加权”方法来提高ICL的性能,以及用于诊断ICL错误的分析框架。这项工作也为未来的相关研究指引了新的方向。

图3.上下文中演示示例的标签词作为“锚点”的示意图

论文作者来自北京大学孙栩教授团队和微信AI团队,其中论文的第一作者王乐安是在微信AI团队实习的北大研究生(本科为北京大学智能科学与技术系2019级全系第一名),这也是他中稿的第一篇自然语言处理领域主会论文。在论文的研究过程中,北京大学孙栩教授团队和微信AI团队紧密合作,在研究方向、核心问题、实验改进、以及论文修改等方面进行了充分的讨论和深入的工作,其中王乐安扎实的数理基础和专业知识,孙栩教授清晰准确的指导和建议令人印象深刻。

深耕前沿技术,微信AI团队多项研究可圈可点

微信AI团队在EMNLP2023的表现充分展示了其在AI领域的专业实力。微信AI团队保持着小而精的团队规模,团队成员几乎全部来自国内外顶尖高校的硕士或博士,一直保持着人才引入的高标准。除了本次EMNLP2023BestPaper(Long)Award,近年来团队成员参与的研究工作已经获得了多个重要奖项,包括RecSys2023BestPaper(Short)Award,ACL2019BestPaper(Long)Award等。

微信AI团队在多个领域的研究都取得了显著的成果。在全球学术界最具权威的机器翻译比赛(WorkshoponMachineTranslation,简称WMT)2020~2022连续三年里获得多个赛道冠军,比赛参与者包括众多来自全球的企业、科研机构和高校所组成的顶尖团队。在2018和2019年的对话系统技术挑战赛(DialogSystemTechnologyChallenge,简称DSTC)中也蝉联多个赛道冠军。

微信AI团队一直致力于业务与学术研究的结合,在业务中挖掘科研课题。他们认为,业务与研究是相互促进的关系:“通过研究来发现更好的方法,最终结果也可以直接应用在业务中。”本次会议中的多项工作已经进一步推动了对话系统、微信翻译、微信读书、微信输入法等多个业务场景的应用。

附:微信AI团队入选的8篇文章

1.LabelWordsareAnchors:AnInformationFlowPerspectiveforUnderstandingIn-ContextLearning

LeanWang,LeiLi,DamaiDai,DeliChen,HaoZhou,FandongMeng,JieZhouandXuSun.

2.HyperNetwork-basedDecouplingtoImproveModelGeneralizationforFew-ShotRelationExtraction

LiangZhang,ChulunZhou,FandongMeng,JinsongSu,YidongChenandJieZhou

3.Re3Dial:Retrieve,ReorGANizeandRescaleConversationsforLong-TurnOpen-DomainDialoguePre-training

JiaxinWen,HaoZhou,JianGuan,JieZhou,MinlieHuang

4.Multi-SourceProbingforOpen-DomainConversationalUnderstanding

YuanxiLi,HaoZhou,JieZhou,MinlieHuang

5.ExplicitPlanningHelpsLanguageModelsinLogicalReasoning

HongyuZhao,KangruiWang,MoYu,HongyuanMei

6.D2TV:DualKnowledgeDistillationandTarget-orientedVisionModelingforMany-to-ManyMultimodalSummarization

YunlongLiang,FandongMeng,JiaanWang,JinanXu,YufengChenandJieZhou

7.UnderstandingTranslationeseinCross-LingualSummarization

JiaanWang,FandongMeng,YunlongLiang,TingyiZhang,JiarongXu,ZhixuLiandJieZhou

8.EnhancingArgumentStructureExtractionwithEfficientLeverageofContextualInformation

YunLuo,ZhenYang,FandongMeng,YingjieLi,JieZhouandYueZhang

雷峰网(公众号:雷峰网)